В этом кейсе мы расскажем, как экспресс-аудит SEO и базовая техническая оптимизация сайта помогла бизнесу получить стабильный и надёжный ресурс. История будет особенно интересна руководителям компаний и владельцам бизнеса, которые хотят понять, почему техническое здоровье сайта — это фундамент, без которого значительная доля маркетингового бюджета может расходоваться впустую.

Содержание:

- Исходная ситуация: отсутствие базовой оптимизации и репутационные риски

- Основная задача: закладка фундамента и устранение накопленных ошибок

- Реализация проекта: анализ скрытых проблем

- «Вишенка на торте»: тёмное прошлое RU-домена

- Особенности и сложности проекта

- Результаты: очистка и первые признаки роста

- Итог

Исходная ситуация: отсутствие базовой оптимизации и репутационные риски

К нам обратился руководитель маркетингового отдела солидного градостроительного института. Организация выполняет госзаказы, разрабатывает генеральные планы городов Краснодарского края, схемы территориального планирования и прочую документацию. Мы уже сотрудничали с ними ранее — разрабатывали несколько лендингов.

На первом созвоне клиент озвучил две болевые точки:

- Потеря видимости по проектам. При поиске объектов, в которых институт участвовал профессионально («градостроительный план Сочи», «градостроительный план Геленджика»), в выдаче доминировали конкуренты. Руководитель отдела маркетинга подозревала, что проблема в SEO-настройках, но не могла определить причину самостоятельно.

- Репутационные риски. В выдаче присутствовали негативные публикации, и клиент хотел «перекрыть» их позитивными статьями, которые мы бы написали и опубликовали.

Гарантировать, что конкретные статьи окажутся в топе выдачи, — это задача SERM-специалистов, которые работают с репутацией в поисковых системах комплексно: анализируют выдачу, выбирают площадки, создают контент и управляют его видимостью. Наша экспертиза — другая: технический аудит, SEO-фундамент, настройка сайта для корректной работы с поисковиками. Поэтому мы предложили клиенту разделить задачи.

Первым шагом стал экспресс-аудит SEO и технического состояния сайта — чтобы выяснить, почему собственные проекты института не видны в поиске и какие системные ошибки мешают продвижению.

Основная задача: закладка фундамента и устранение накопленных ошибок

Перед нами стояла комплексная задача:

- Провести базовый SEO-аудит для выявления скрытых проблем;

- Исправить критические технические ошибки, препятствующие индексации;

- Оптимизировать структуру и контент, чтобы обеспечить рост позиций в выдаче.

Задача осложнялась тем, что сайт построен на базе устаревшей версии Laravel 5.5 под управлением October CMS, а используемая версия PHP 7.3 также давно не поддерживается, в связи с чем найти готовые плагины было значительно сложнее.

Реализация проекта: анализ скрытых проблем

В процессе работы мы обнаружили типичные ошибки, характерные для сайтов, оптимизацией которых владельцы обычно не занимались или не уделили ей должного внимания.

С помощью парсера Screaming Frog SEO Spider мы просканировали сайт и выявили самые обычные ошибки, среди которых отобрали наиболее приоритетные:

1. Управление индексацией: robots.txt и sitemap.xml

При первичном сканировании с помощью парсера Screaming Frog SEO Spider выяснилось, что на сайте отсутствовали два критически важных файла: robots.txt и sitemap.xml. Без них поисковые роботы либо сканировали сайт бесконтрольно (тратя лишний краулинговый бюджет на служебные или технические страницы), либо вовсе не заходили в нужные разделы.

Robots.txt — это директива, которая говорит роботам: «эти страницы можно просматривать, а эти — нет». Sitemap.xml — это карта сайта в формате XML, перечисляющая все важные URL для ускоренной индексации.

Как решили: создали оба файла с нуля. Из-за старой CMS генератор для sitemap.xml пришлось дописывать вручную. После этого роботы получили чёткие инструкции: какие страницы сканировать, а какие — игнорировать.

2. Контент и заголовки: Title, Description, H1

Следующая проблема — полное отсутствие базовых метатегов и заголовков (Title, Description).

Title — это то, что пользователь видит синей ссылкой в выдаче. Description — краткое описание под ней. Без них поисковики вынуждены самостоятельно «выдергивать» фрагменты текста, что часто выглядит нерелевантно и снижает кликабельность.

Что касается заголовков внутри страницы: вместо главного заголовка H1 использовался второстепенный H2, и тот находился ниже «первого сгиба» — то есть пользователь видел контент, но не сразу понимал тему раздела. На главной странице H1 отсутствовал вовсе.

Что сделали:

- Завели и заполнили поля Title, Description, H1 для всех типовых страниц;

- Автоматически «перелили» значения существовавших H2 в новые H1, после чего удалили H2 из контента, чтобы не путать структуру;

- Для главной страницы добавили H1 со стилем «hidden» (скрытый, но доступный для поисковых роботов) как для русской, так и для английской версии сайта.

3. Системные ошибки: редиректы и цепочки

Парсер обнаружил более 73 000 URL с временными редиректами (302). Временная переадресация говорит поисковику, что страница перемещена ненадолго, и со временем её нужно будет вернуть. Однако в нашем случае адреса были изменены насовсем, а 302 код заставлял роботов каждый раз проверять исходный URL, тратя ресурсы. Кроме того, встречались цепочки переадресаций (например, страница А → Б → В), что замедляло загрузку и «размывало» вес ссылок.

Принятые решения:

- Заменили все 302 на постоянные редиректы 301 (код, который сообщает: «страница переехала навсегда, передай вес новой»);

- Убрали цепочки: теперь каждый старый адрес ведёт на конечный URL за один шаг.

4. Канонические адреса: rel="canonical"

На сайте отсутствовал атрибут rel="canonical". Это создавало риск дублирования контента, особенно для страниц с фильтрами (например, /catalog?sort=price и /catalog?sort=name могли считаться разными страницами при одинаковом содержимом).

Canonical указывает поисковику, какая версия URL является основной и должна участвовать в ранжировании.

Было выполнено следующее: добавили canonical на все страницы. Параметрические адреса (с фильтрами) оставили рабочими для пользователей, но в canonical прописали "чистую" версию без параметров.

5. Структура URL: параметры, слеши, ЧПУ

Было выявлено несколько проблем с адресами:

- Использовались параметры с неинформативными значениями (например, &f=s вместо буквенного или числового идентификатора);

- Страницы с конечным слешем (/catalog/) и без слеша (/catalog) открывались как разные, что порождало дубли;

- Сайт генерировал невалидные URL, например: /2029 в новостях (хотя новостей за такой год ещё нет), /projects?f=s&v=277777 (проекта с таким id не существует), а также любые произвольные адреса вроде /projects?f=pishu_tut_chto_hochu — теоретически можно было создать любой «плохой» URL и купить на него ссылки, и он бы «существовал» на сайте.

Реализованный подход:

- Привели все URL к единому формату без слеша на конце, настроили автоматические 301 редиректы со слешем на вариант без слеша;

- Внедрили ЧПУ (человекопонятные URL) — вместо параметров стали использовать читаемые адреса вида /category/product-name;

- Настроили отдачу корректного 404 статуса (страница не найдена) для всех несуществующих или невалидных URL, чтобы поисковики не индексировали «фантомов», а злоумышленники не могли наращивать ссылочную массу на пустых страницах.

6. Внешние ссылки: токсичные доноры

При анализе ссылочного профиля мы проверили, нет ли доноров, которые могут навредить ранжированию (так называемые токсичные ссылки — с сайтов низкого качества, дорвеев, санкционных ресурсов). В теории такие ссылки можно отклонить через инструмент Disavow (файл отклонения ссылок), чтобы Google их игнорировал.

Итог: критически нежелательных ссылок не выявили. Чтобы не потерять ссылочную массу, не стали отклонять старые ссылки (в Google использование Disavow может быть избыточным, если явного вреда нет).

«Вишенка на торте»: тёмное прошлое RU-домена

Анализируя панель вебмастера Яндекс, мы заметили в ней раздел «Видео», хотя на самом сайте видеоконтент отсутствовал. Чтобы разобраться в причине, мы изучили историю домена через Web Archive. Оказалось, что много лет назад этот домен принадлежал совсем другой организации.

История домена оказалась богатой на события: сначала всё шло гладко — на нём располагался сайт другого института ( «белая» тематика). Но затем, судя по всему, домен не продлили вовремя, его перекупил частный вебмастер как «дроп-домен», и тут началось самое интересное:

- несколько лет домен использовался для видеохостинга;

- позже на нём появился женский блог;

- затем — видео для взрослых;

- а после — девушки «с пониженной социальной ответственностью» проводили через него свои трансляции.

Всё это успело обрасти ссылочной массой, но в основном ссылки вели на конкретные видеоролики.

В 2022 году нынешние владельцы выкупили этот домен, чтобы закрепить за собой адрес в зоне «.RU», поскольку основной сайт находится в зоне «.COM». Не проверив историю домена, они настроили прямой редирект на свой основной сайт. Поисковые системы продолжали переходить по старым ссылкам, ведущим на страницы видеохостинга, и фиксировали множество ошибок 404.

Мы предложили два варианта: убрать прямой редирект и разместить на домене RU обычную текстовую ссылку на домен «.COM», либо оставить 301-й редирект (чтобы не терять ссылочную массу), но закрыть старые проблемные директории от индексации. В итоге совместно с клиентом мы решили сохранить редирект, но полностью скрыли несуществующие разделы через файл robots.txt — так мы прекратили передачу сигналов об ошибках в поисковые системы.

Особенности и сложности проекта

Главная сложность заключалась не в стандартных технических правках, а в работе с устаревшей архитектурой сайта.

- Устаревший стек технологий. Сайт был построен на старых версиях фреймворка Laravel (PHP). Готовых модулей для генерации sitemap или корректной работы с заголовками не существовало. Программисту пришлось разрабатывать функционал с нуля.

- Работа с человеческим фактором. Заказчик чувствовал, что сайт работает некорректно: падают позиции, тормозит, что-то не настроено. Но внутри команды не было компетенций, чтобы диагностировать и исправить проблемы. Наша задача была — чётко показать, какие именно технические ошибки мешают продвижению, и предложить план их устранения. Мы предложили план базовой оптимизации, где каждый шаг закрывал конкретную, уже заметную клиенту проблему.

- Доверие и экспертиза. У клиента уже был негативный опыт с другими подрядчиками (в том числе PR-компаниями). Нам было важно доказать, что мы решаем глубинные проблемы, даже если их не видно на первый взгляд. Мы показали заказчику, как техническое состояние сайта влияет на его уязвимость, где именно «не настроено» и как исправить. Клиент увидел реальные улучшения и прозрачные метрики — и убедился в нашей компетенции. Именно экспертиза стала основой сотрудничества.

Результаты: очистка и первые признаки роста

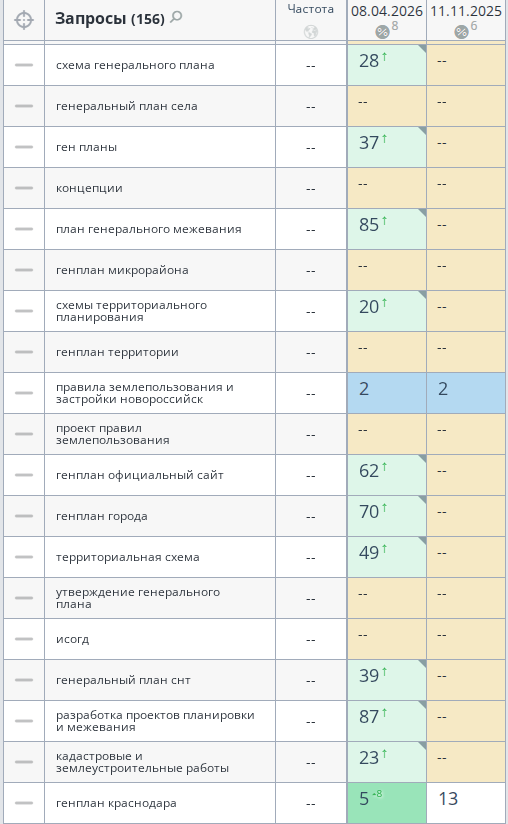

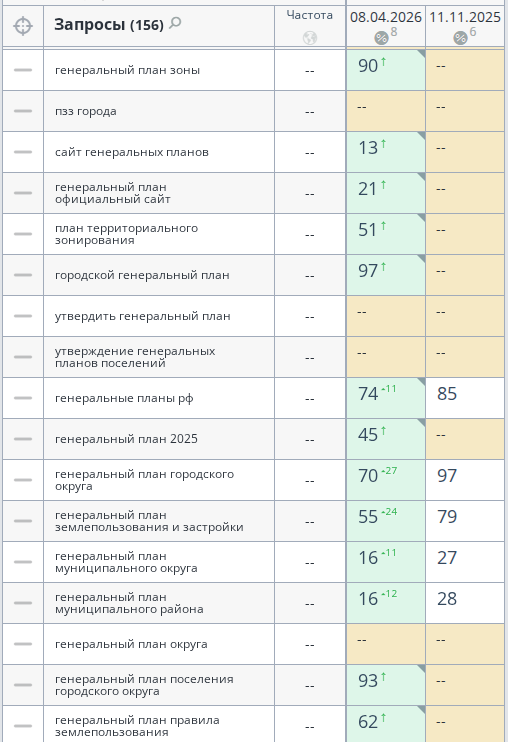

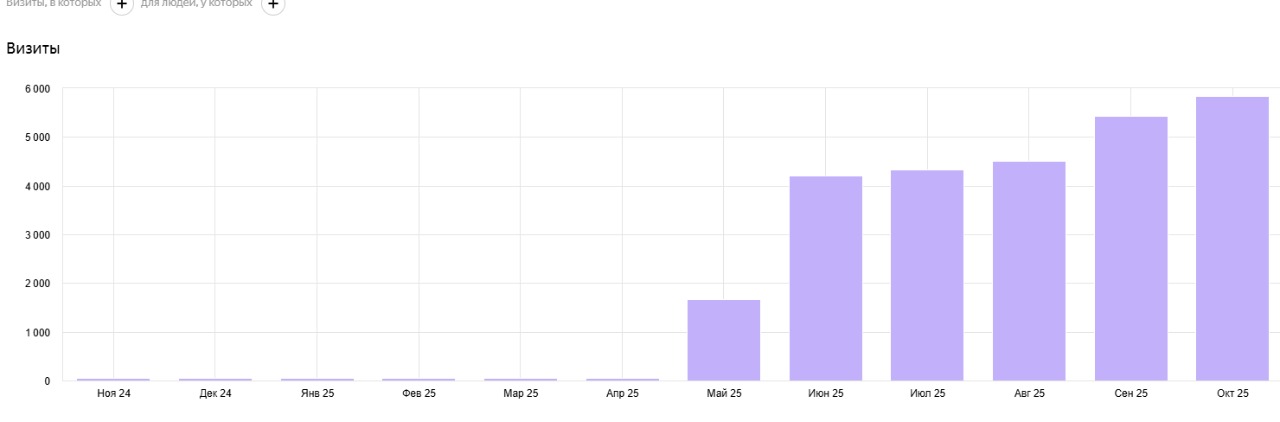

Трафик из поисковых систем за ноябрь 2025 года.

Примеры поисковых запросов, по которым позиции сайта выросли органически за счет технической оптимизации (без дальнейшего продвижения) к апрелю 2026 года.

Несмотря на то, что клиент изначально хотел получить мгновенный PR-эффект, мы сфокусировались на техническом фундаменте. Это принесло результат:

- Устранение технических препятствий. Мы ликвидировали критические ошибки: создали robots.txt и sitemap.xml, исправили тысячи редиректов и закрыли от индексации «токсичные» директории, связанные со старой историей домена, настроили канонические адреса, привели URL к единому формату, отклонили опасные внешние ссылки через disavow и очистили индекс от «фантомов» через 404.

- Появление видимости. До наших работ у сайта практически отсутствовала видимость в поиске. После внесения правок в Яндексе начали появляться первые позиции. Особенно заметен рост по информационным запросам.

- Автоматизация оптимизации. Мы внедрили шаблон, благодаря которому каждая новая публикация (новость, статья) теперь создается уже с минимальной, но корректной SEO-настройкой по умолчанию. Это позволило компании накапливать контент без риска повторения прошлых ошибок.

Итог

Мы полностью подготовили сайт технически: настроили индексацию, шаблоны, карту сайта, robots.txt, убрали ошибки, сэкономили краулинговый бюджет и максимально отделили ru-домен от com, а также дали рекомендации по текстам, ссылкам и чистке архива web.archive.org. Контентные ошибки мы не исправляли — эту часть работ клиент взял на себя. Это позволило компании получить чистый, готовый к дальнейшему продвижению ресурс и начать постепенно восстанавливать свою видимость в поиске, не опасаясь, что старое наследие домена перечеркнёт все усилия.

Мы сделали ставку на собственный ресурс клиента: оптимизировали корпоративный сайт, чтобы он стал технически здоровым и понятным. Закупка статей на сторонних площадках — это отдельный канал продвижения, и мы не противопоставляем его нашей работе. Но без технической базы этот канал работает в разы хуже.

Важно, что после наших настроек клиент может самостоятельно вести сайт и добавлять новые материалы, не опасаясь случайных ошибок. Это даёт ему независимость и устойчивость.

Если вы столкнулись с похожей ситуацией — сайт тормозит, выдаёт ошибки, теряет позиции в выдаче или просто вызывает сомнения в надёжности после смены подрядчика, — мы готовы провести для вас комплексную проверку. ИТ‑интегратор СТЕК предлагает услугу технического аудита сайта. Мы анализируем как серверную часть (скорость, устойчивость к нагрузкам, безопасность, качество кода), так и публичную: верстку, навигацию, корректность работы сторонних сервисов.

Свяжитесь с нами, чтобы обсудить возможности технической оптимизации для вашего бизнеса.